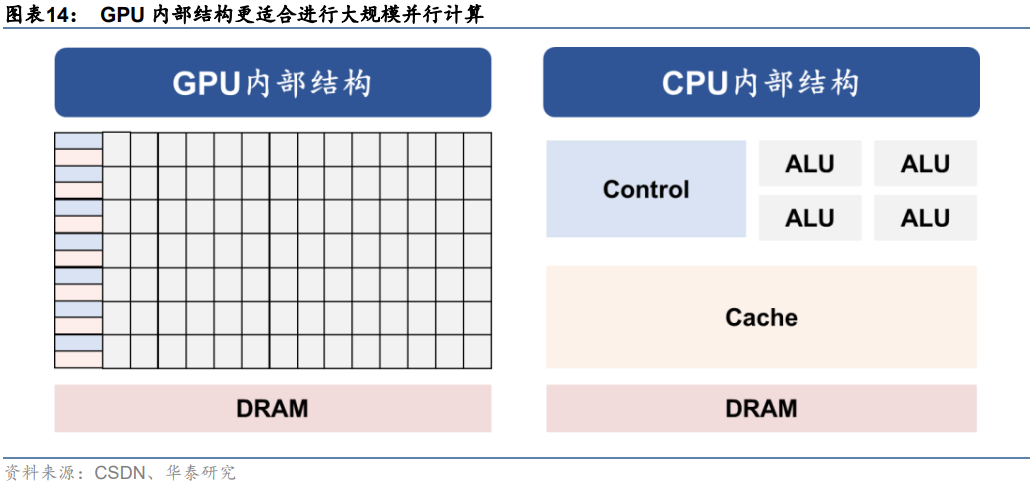

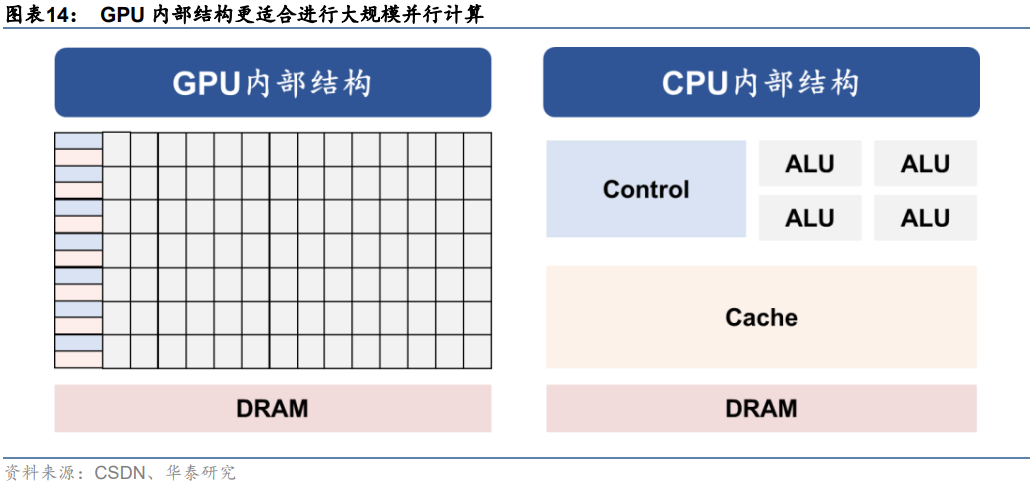

从ChatGPT模型计算方式来看,主要特征是采用了并行计算。对比上一代深度学习模型RNN来看,Transformer架构下,AI模型可以为输入序列中的任何字符提供上下文,因此可以一次处理所有输入,而不是一次只处理一个词,从而使得更大规模的参数计算成为可能。而从GPU的计算方式来看,由于GPU采用了数量众多的计算单元和超长的流水线,因此其架构设计较CPU而言,更适合进行大吞吐量的AI并行计算。

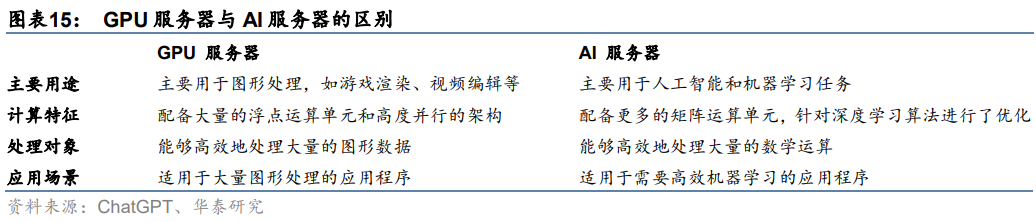

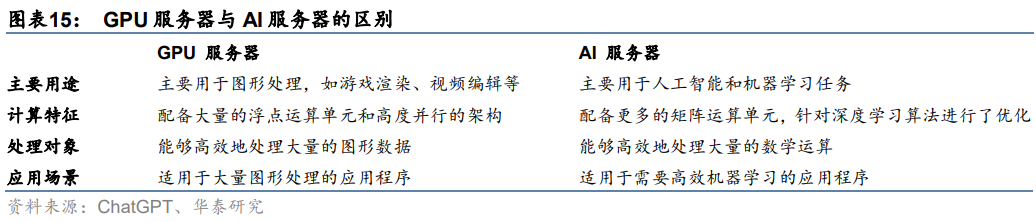

深度学习主要进行矩阵向量计算,AI服务器处理效率更高。从ChatGPT模型结构来看,基于Transformer架构,ChatGPT模型采用注意力机制进行文本单词权重赋值,并向前馈神经网络输出数值结果,这一过程需要进行大量向量及张量运算。而AI服务器中往往集成多个AI GPU,AI GPU通常支持多重矩阵运算,例如卷积、池化和激活函数,以加速深度学习算法的运算。因此在人工智能场景下,AI服务器往往较GPU服务器计算效率更高,具备一定应用优势。

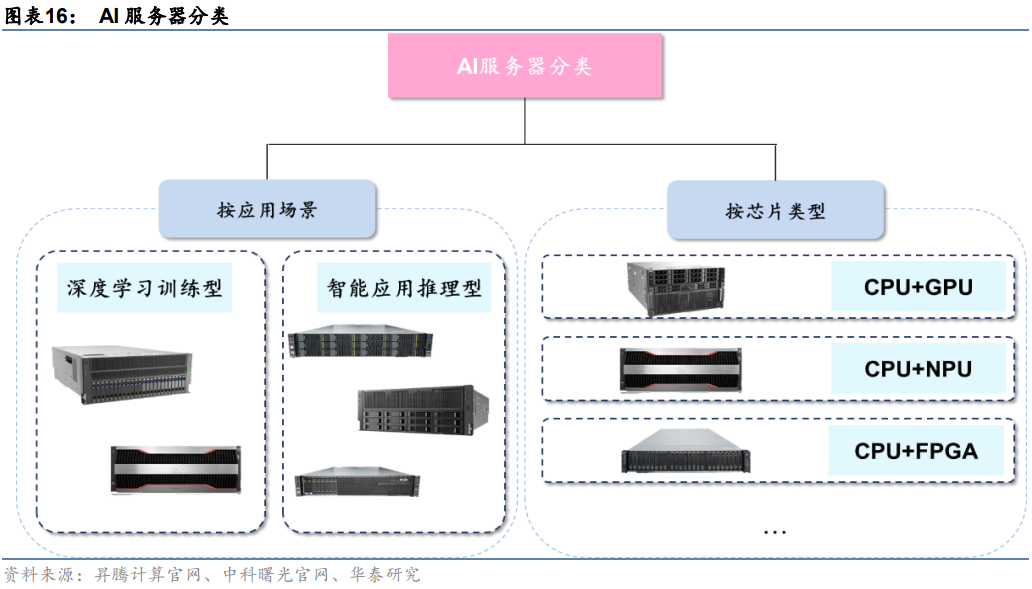

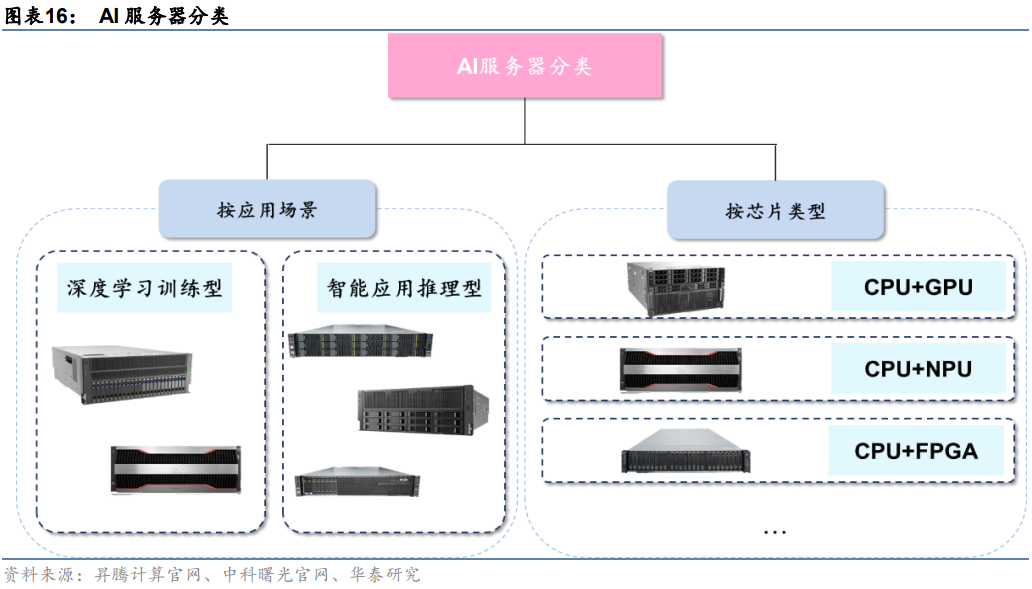

AI服务器分类方式有两种:

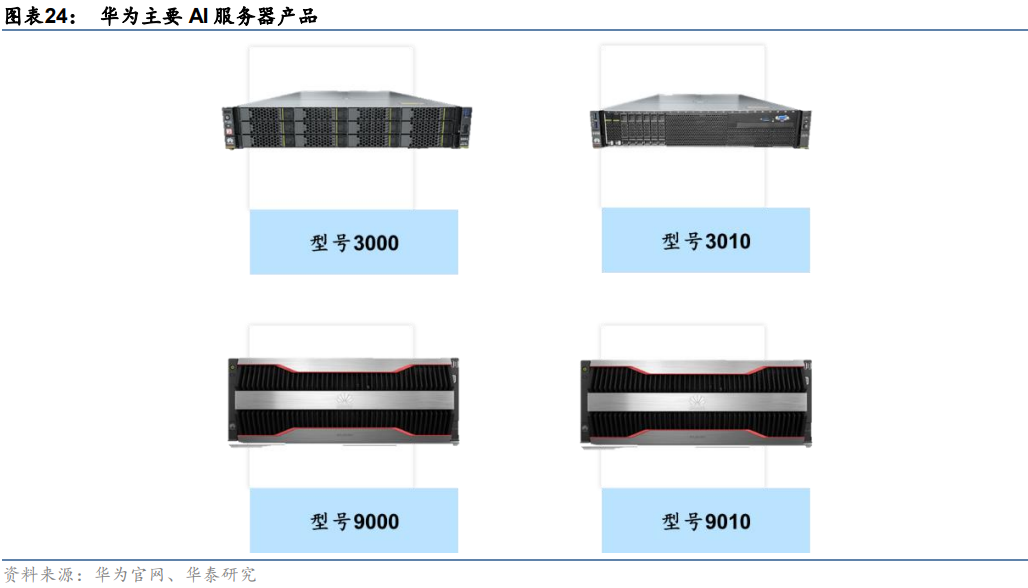

1)按应用场景:AI服务器按照应用场景可以分为深度学习训练型和智能应用推理型。训练任务对服务器算力要求较高,需要训练型服务器提供高密度算力支持,典型产品有中科曙光X785-G30和华为昇腾Atlas 800(型号9000、型号9010)。推理任务则是利用训练后的模型提供服务,对算力无较高要求,典型产品有中科曙光X785-G40和华为昇腾Atlas 800(型号3000、型号3010)。2)按芯片类型:AI服务器为异构服务器,可以根据应用范围调整计算模块结构,可采用CPU+GPU、CPU+FPGA、CPU+TPU、CPU+ASIC或CPU+多种加速卡等组合形式。目前,产品中最常见的是CPU+多块GPU的方式。

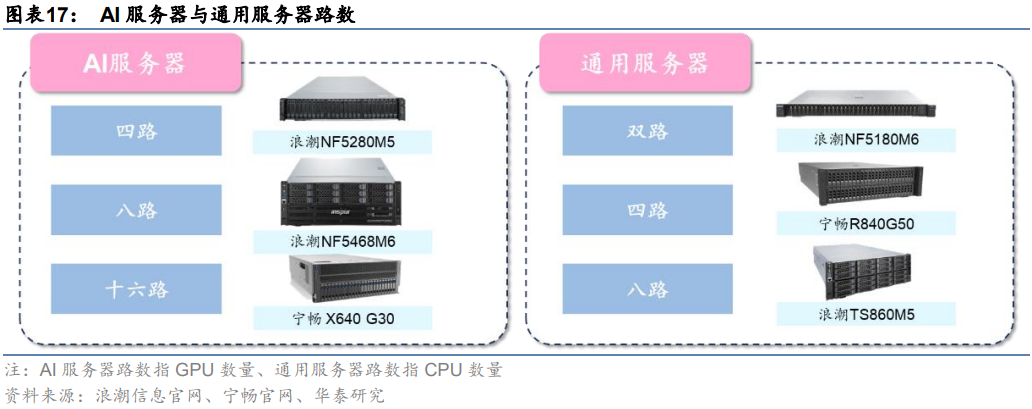

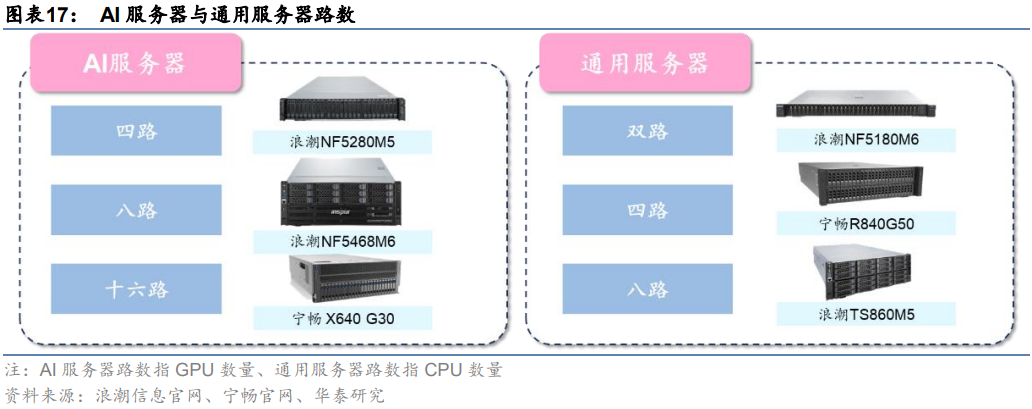

常见的AI服务器分为四路、八路、十六路。一般来说,通用服务器主要采用以CPU为主导的串行架构,更擅长逻辑运算;而AI服务器主要采用加速卡为主导的异构形式,更擅长做大吞吐量的并行计算。按CPU数量,通用服务器可分为双路、四路和八路等。虽然AI服务器一般仅搭载1-2块CPU,但GPU数量显著占优。按GPU数量,AI服务器可以分为四路、八路和十六路服务器,其中搭载8块GPU的八路AI服务器最常见。

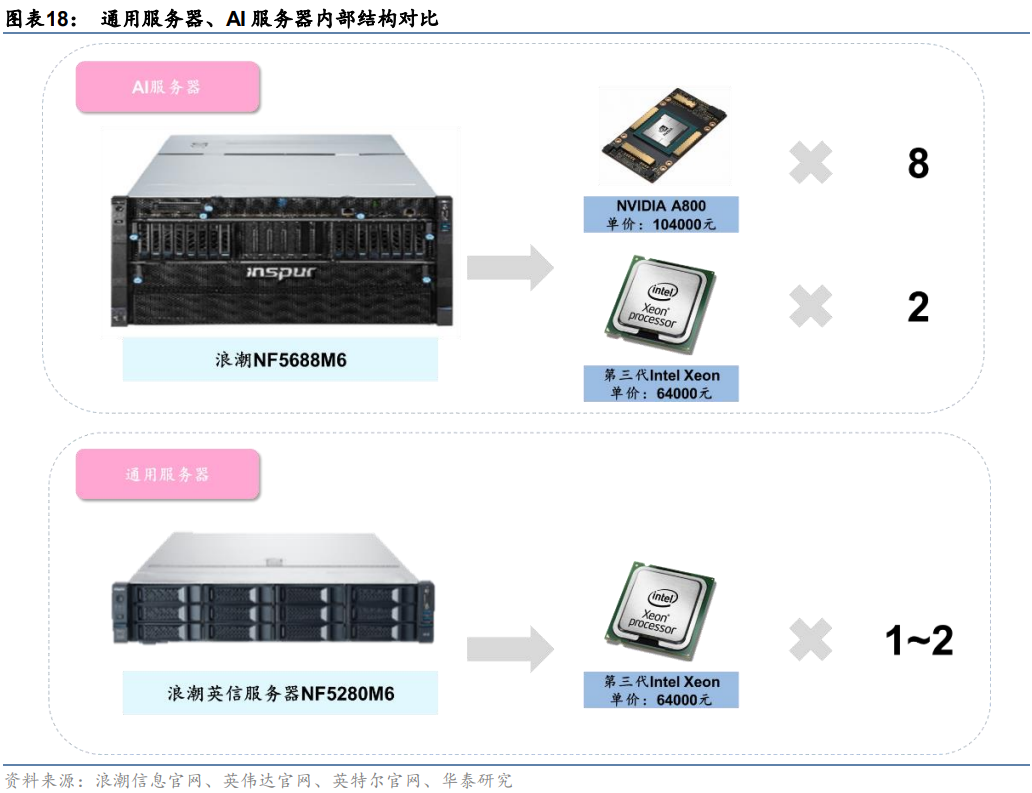

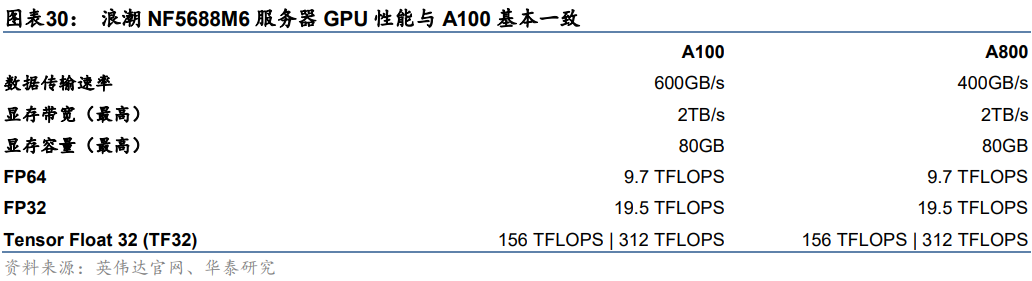

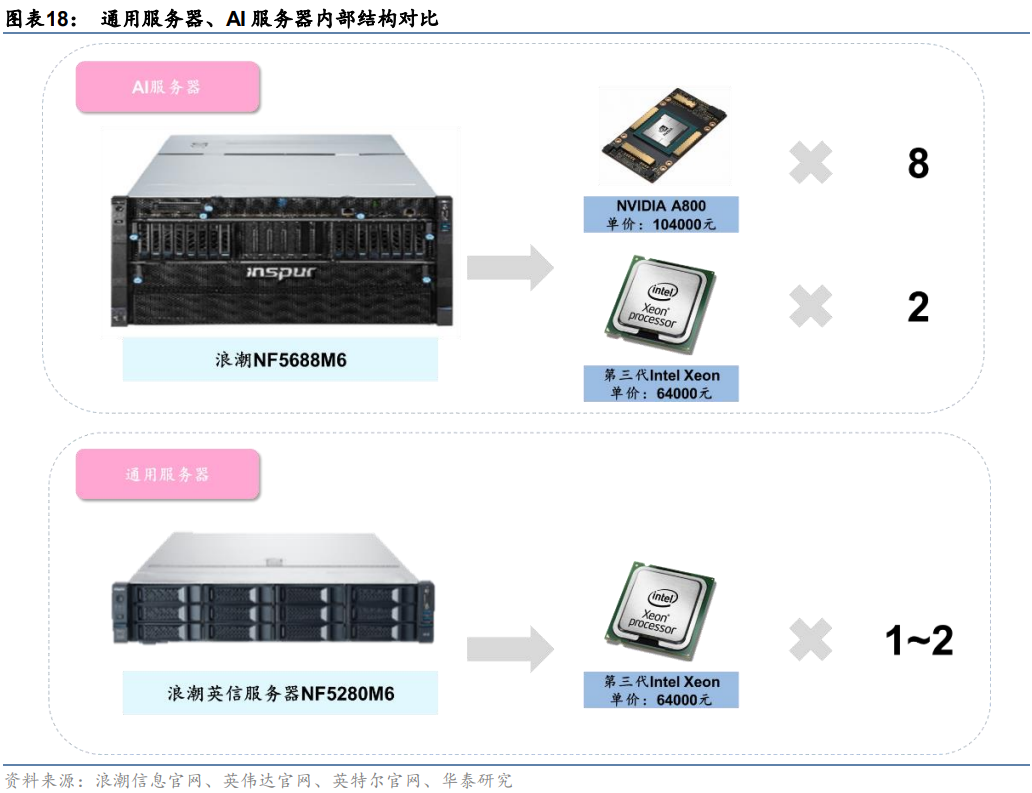

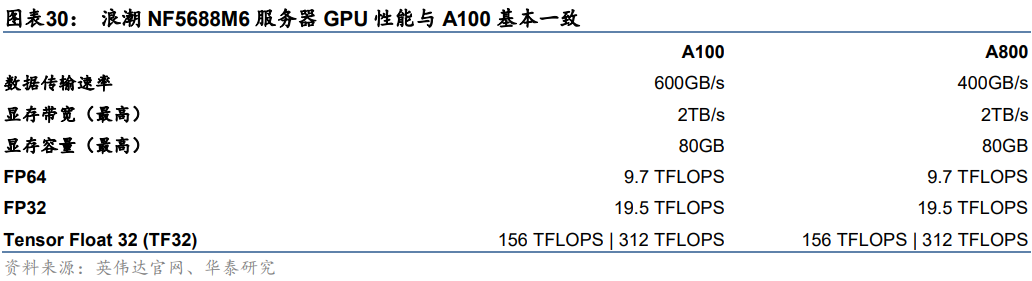

AI服务器采用多芯片组合,算力硬件成本更高。我们以典型服务器产品为例拆解硬件构成,可以更清晰地理解两类服务器硬件架构区别:以浪潮通用服务器NF5280M6为例,该服务器采用1~2颗第三代Intel Xeon可扩展处理器,据英特尔官网,每颗CPU售价约64000万元,故该服务器芯片成本约64000~128000;以浪潮AI服务器NF5688M6为例,该服务器采用2颗第三代Intel Xeon可扩展处理器+8颗英伟达A800 GPU的组合,据英伟达官网,每颗A800售价104000元,故该服务器芯片成本约96万元。

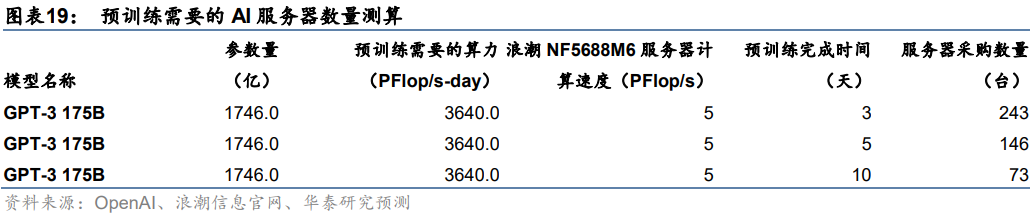

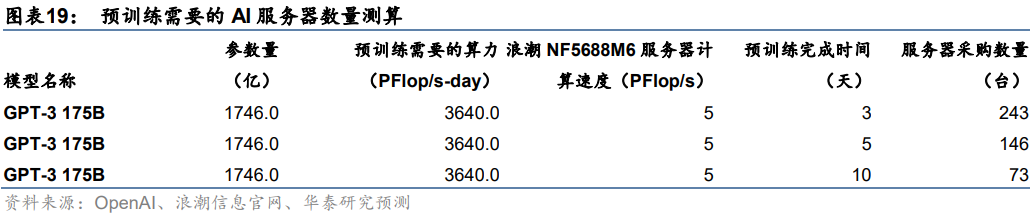

GPT模型训练需要大算力支持,或将带来AI服务器建设需求。我们认为,随着国内厂商陆续布局ChatGPT类似产品,GPT大模型预训练、调优及日常运营或将带来大量算力需求,进而带动国内AI服务器市场放量。以GPT-3 175B模型预训练过程为例,据OpenAI,进行一次GPT-3 175B模型的预训练需要的算力约3640 PFlop/s-day。我们假设以浪潮信息目前算力最强的AI服务器NF5688M6(PFlop/s)进行计算,在预训练期限分别为3、5、10天的假设下,单一厂商需采购的AI服务器数量分别为243、146、73台。

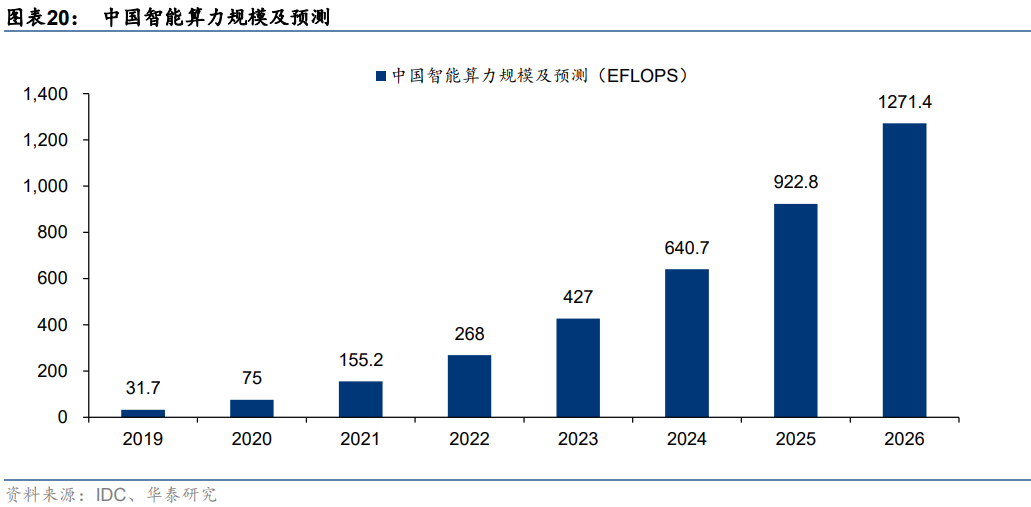

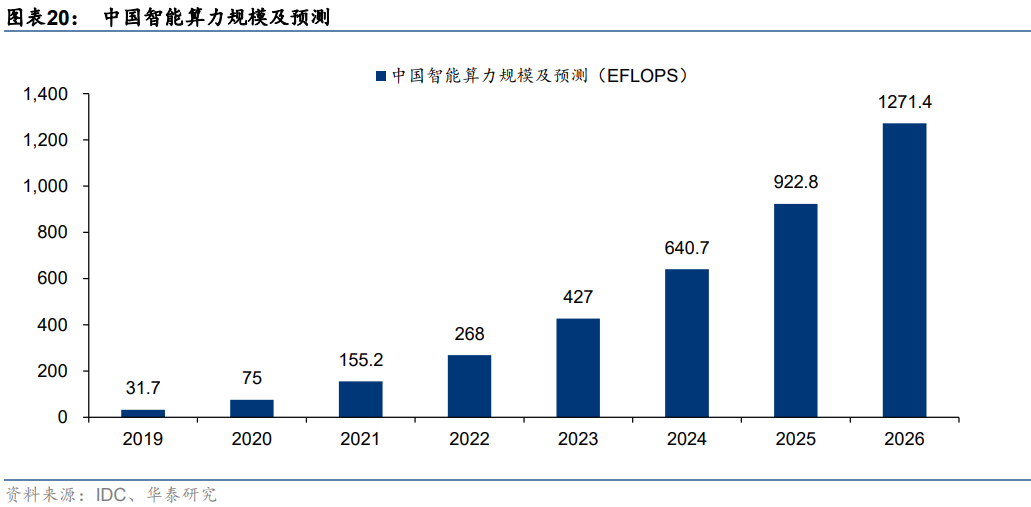

AI大模型训练需求火热,智能算力规模增长有望带动AI服务器放量。据IDC数据,以半精度(FP16)运算能力换算,2021年中国智能算力规模约155.2EFLOPS。随着AI模型日益复杂、计算数据量快速增长、人工智能应用场景不断深化,未来国内智能算力规模有望实现快速增长。IDC预计2022年国内智能算力规模将同比增长72.7%至268.0 EFLOPS,预计2026年智能算力规模将达1271.4 EFLOPS,2022-2026年算力规模CAGR将达69.2%。我们认为,AI服务器作为承载智能算力运算的主要基础设施,有望受益于下游需求放量。

国产厂商布局丰富产品矩阵,占据全球AI服务器市场领先地位

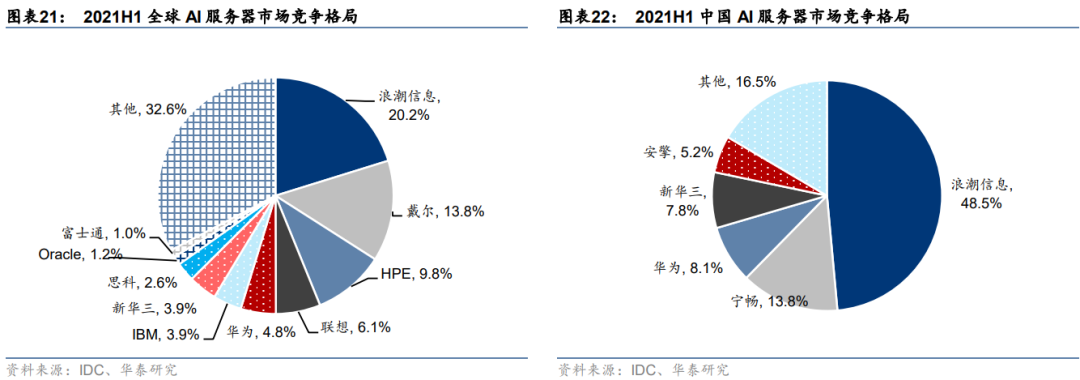

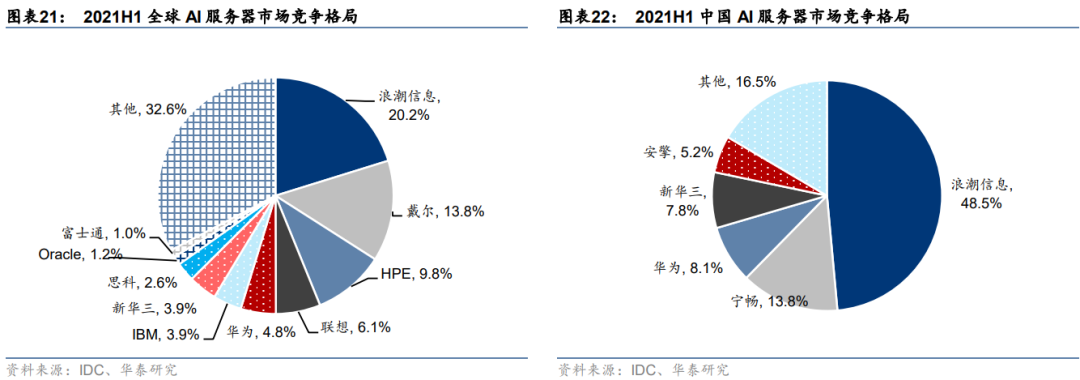

浪潮信息、联想、华为等国产厂商在全球AI服务器市场占据领先地位。全球市场来看,AI服务器市场份额TOP10厂商中,国产厂商占据4席,累计市场份额超35%,其中浪潮信息以20.2%的份额排名第一。国内市场来看,AI服务器市场集中度较高,排名前三的供应商为浪潮信息、宁畅和华为,CR3达70.40%。我们认为,国产厂商凭借强大产品竞争力,已经在国际市场占据一定领先地位,未来随着AI算力需求释放,有望充分受益于产业成长机遇。

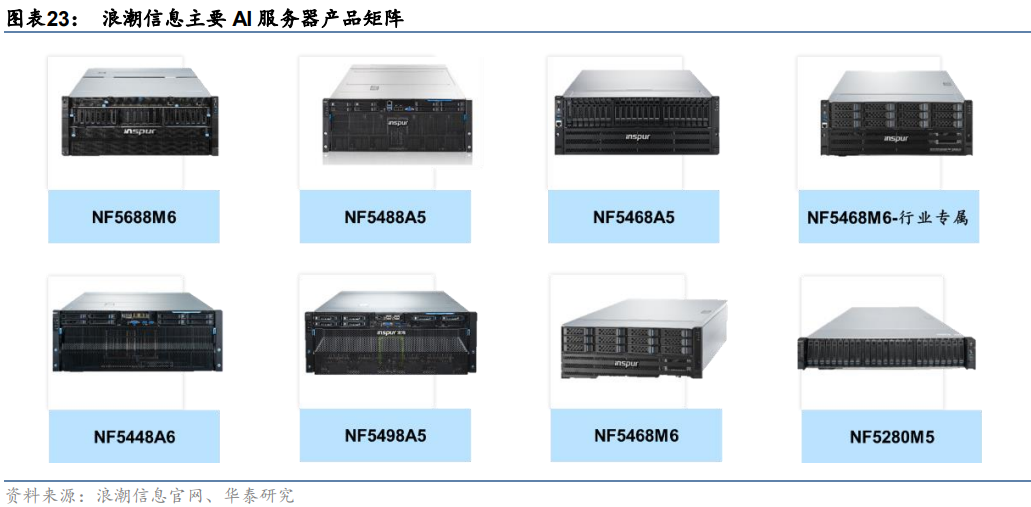

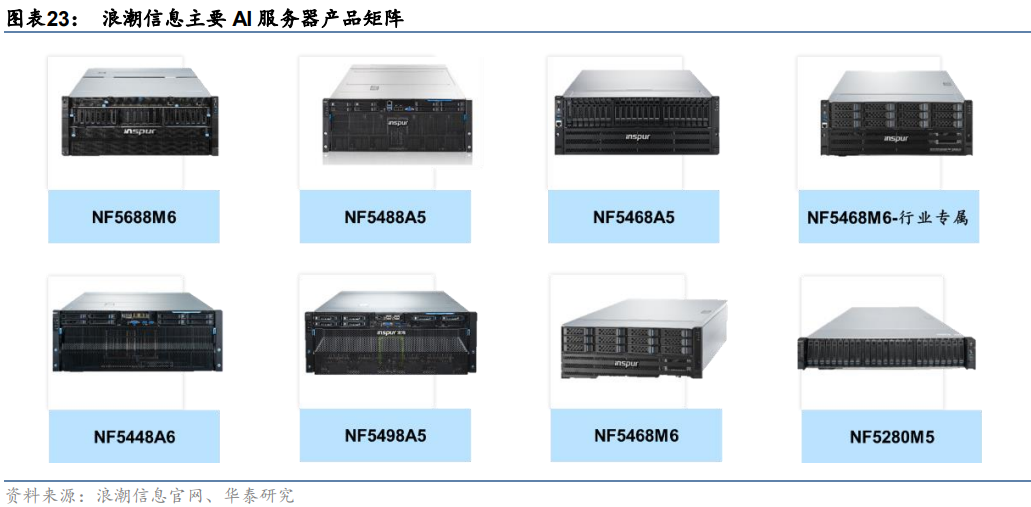

浪潮信息:AI服务器产品矩阵丰富,产品力获国际认可。目前公司AI服务器主要产品型号包括NF5688M6、NF5488A5等,据公司官网,2021年上述两款AI服务器在国际权威AI基准测试MLPerf榜单中,获得医学影像分割、目标物体检测、自然语言理解、智能推荐等7项训练冠军,可满足包括自然语言理解等在内的多项AI训练需求。此外,公司在AI领域的积累还包括AI资源平台、AI算法平台等,具备大量算力解决方案实施经验。

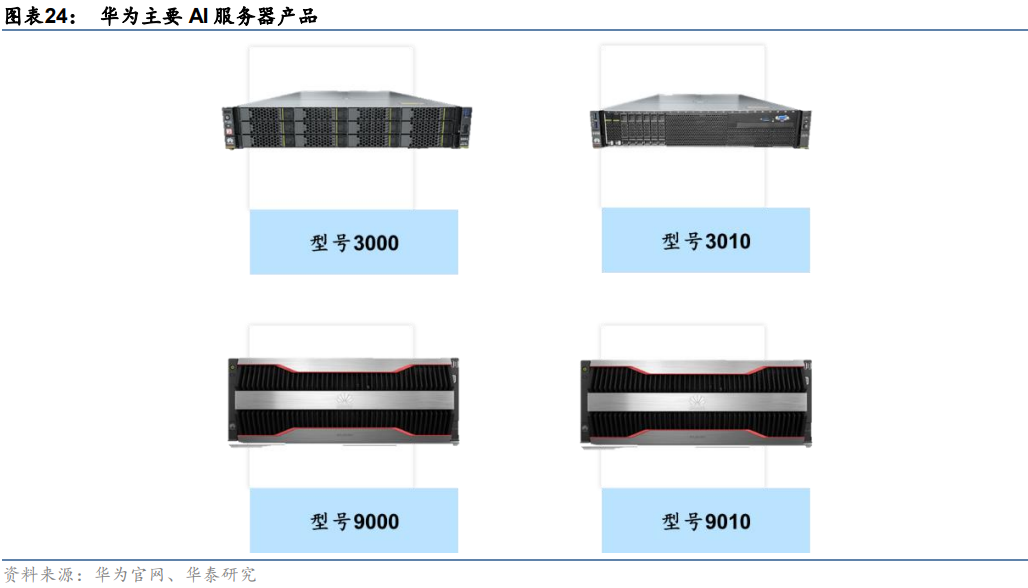

华为:AI服务器融合自研加速卡与英特尔CPU。公司AI服务器为Atlas 800推理服务器系列,旗下有型号3000、型号3010、型号9000和型号9010。其中,型号3000基于昇腾310芯片,型号3010基于Intel处理器,型号9000基于华为鲲鹏920+昇腾910处理器,型号9010基于Intel处理器+华为昇腾910芯片。旗舰级芯片加持下,产品最高拥有2.24 PFLOPS FP16的高密度算力,并在设计结构优化下,芯片间跨服务器互联时延可缩短10~70%。

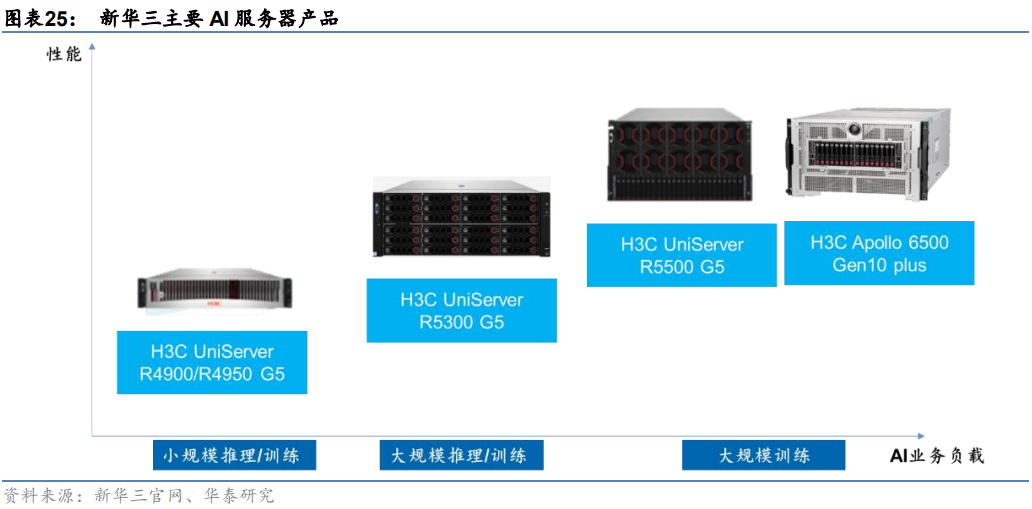

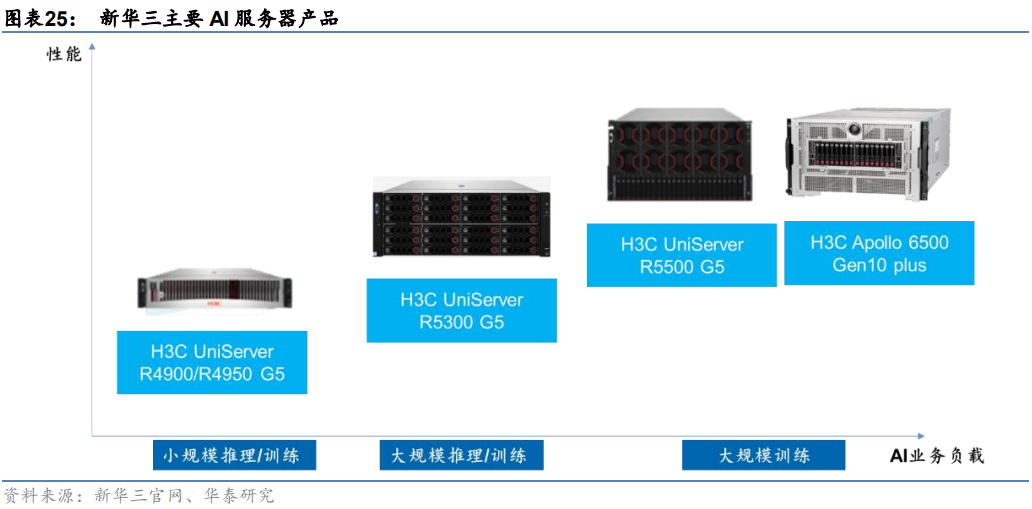

新华三AI服务器覆盖各训练负载要求,结合软件平台构建AI完整生态。公司主要产品型号包括R4900 G5、R5300 G5、R5500 G5等,可分别针对不同训练负载要求,满足大小规模的推理/训练任务。软件层面,公司通过新华三傲飞AI/HPC融合管理平台,全面提升AI作业效率约32%。2022年,新华三被国际权威分析机构Forrester认定为大型人工智能系统成熟厂商,可以提供可靠的服务器解决方案。同时,新华三AI服务器在MLPerf测评中共斩获86项世界第一。

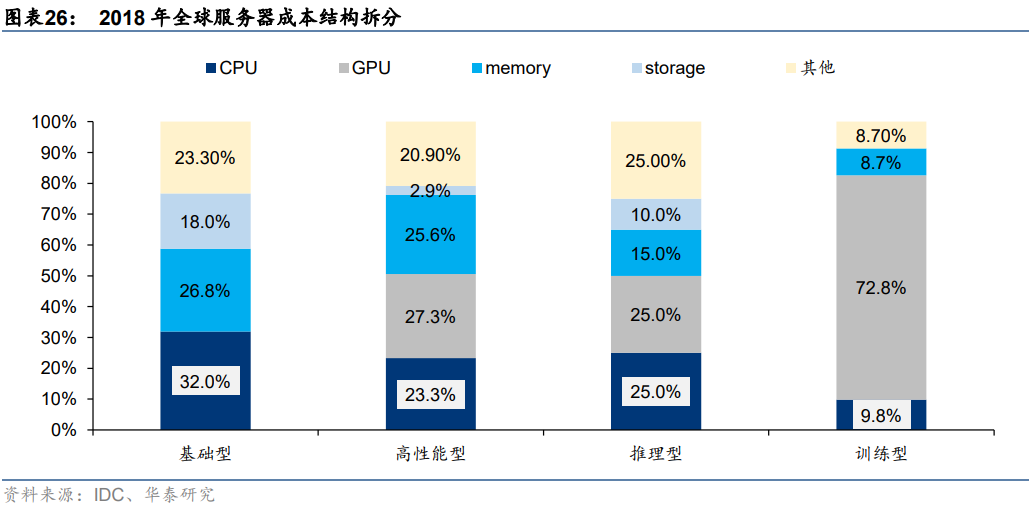

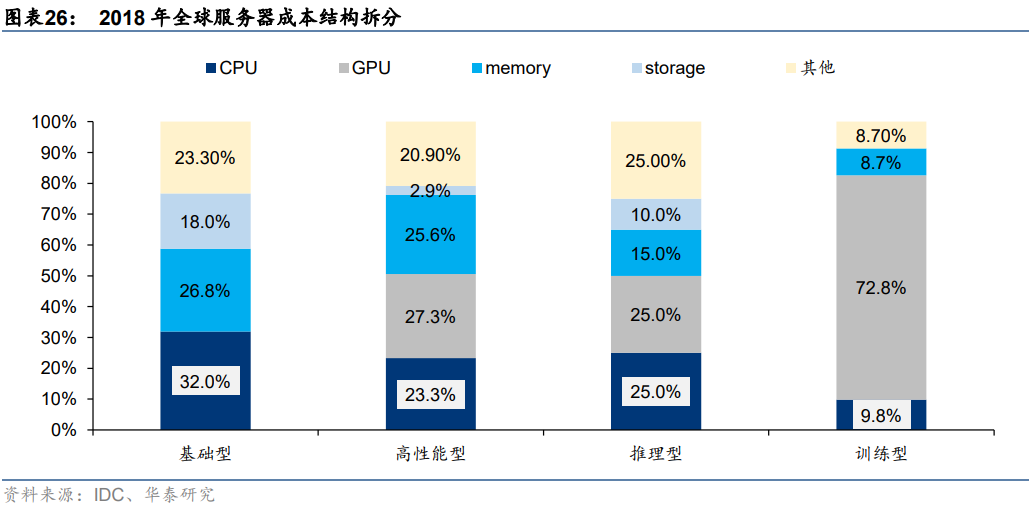

龙头厂商有望充分受益于算力需求释放。我们认为,随着ChatGPT待动大模型训练热潮,以人工智能训练为代表的智能算力需求逐步释放,有望带动AI服务器放量。拆解AI服务器成本来看,GPU等算力芯片为核心组件,先进算力产品受美国出口管制影响,但可通过采购A800实现基本替代。我们认为,浪潮信息等国产头部厂商凭借丰富产品矩阵和强大产品竞争力,占据全球AI服务器市场主要份额,未来有望充分受益于服务器需求释放。拆解来看,AI服务器主要成本包括算力芯片、内存、存储等。据IDC的2018年服务器成本结构拆分数据,芯片成本在基础型服务器中约占总成本的32%,在高性能或具有更强运算能力的服务器中,芯片相关成本占比可以高达50%-83%。以机器学习型AI服务器为例,其主要成本由GPU、CPU、内存及其他部件组成,其中GPU成本占比最高,达到72.8%。

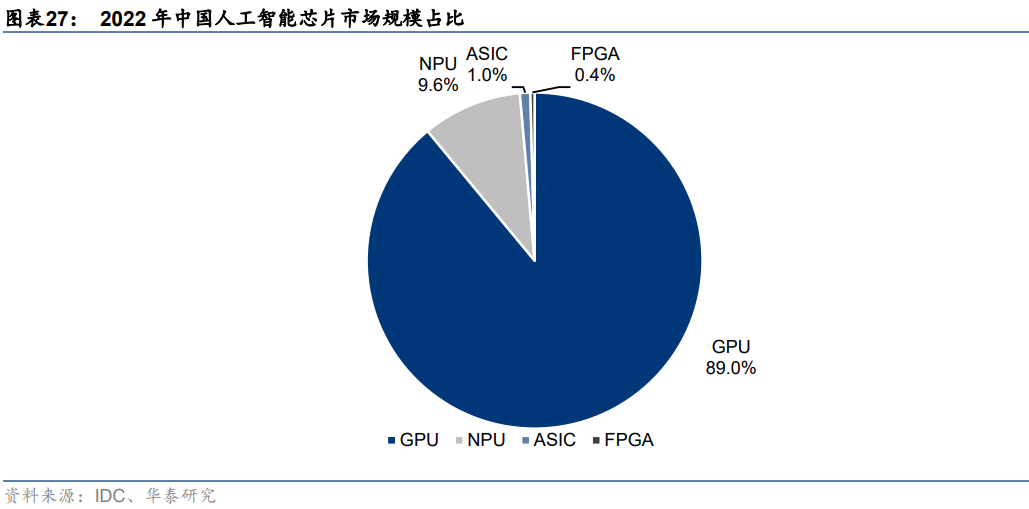

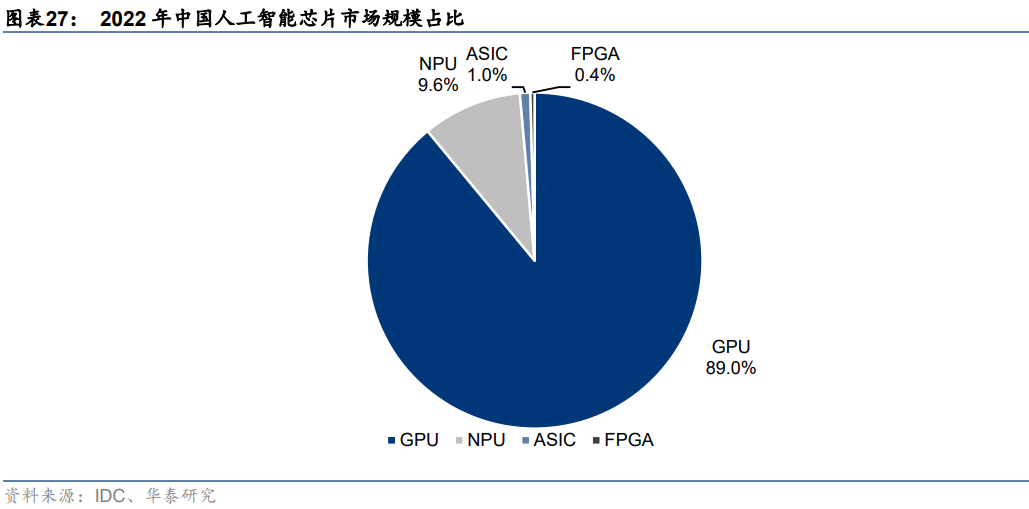

AI服务器算力芯片以GPU为主。据IDC,2022年国内人工智能芯片市场中,GPU芯片占据主要市场份额,达89.0%,主因GPU芯片并行计算架构更加适合于复杂数学计算场景,可以较好支持高度并行的工作负载,因此常用于数据中心的模型训练,以及边缘侧及端侧的推理工作负载。此外,其他主要的人工智能芯片还包括NPU、ASIC、FPGA等。一般而言,AI服务器中算力芯片需求数量取决于服务器设计性能要求,需求种类取决于成本、功耗、算法等指标。常见的算力芯片组合,如8x GPU+2x CPU、4x GPU+ 2x CPU、8x FPGA+1x CPU、4x FPGA+1x CPU等。

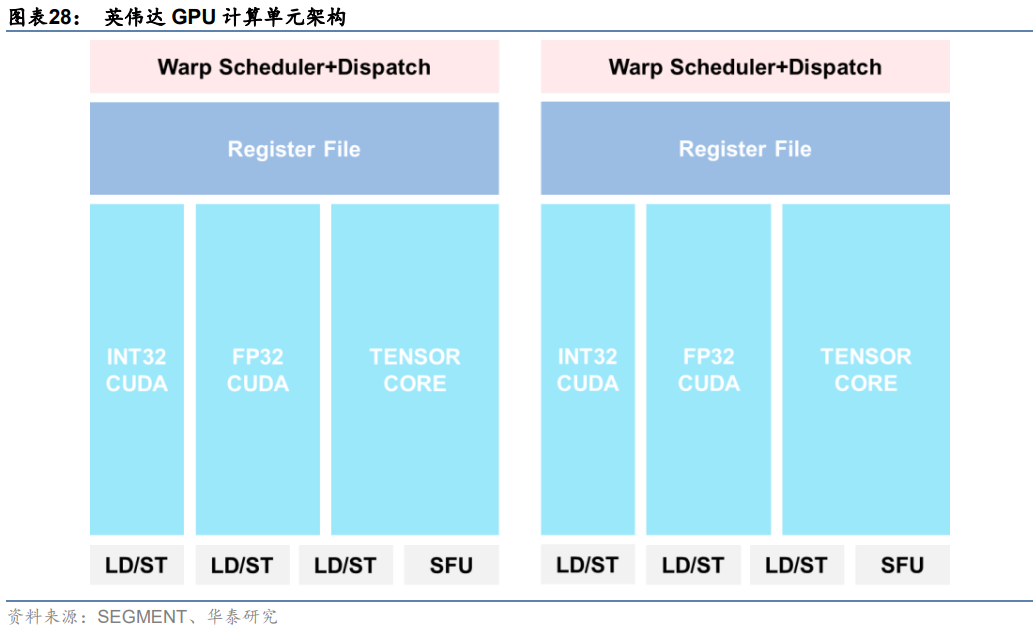

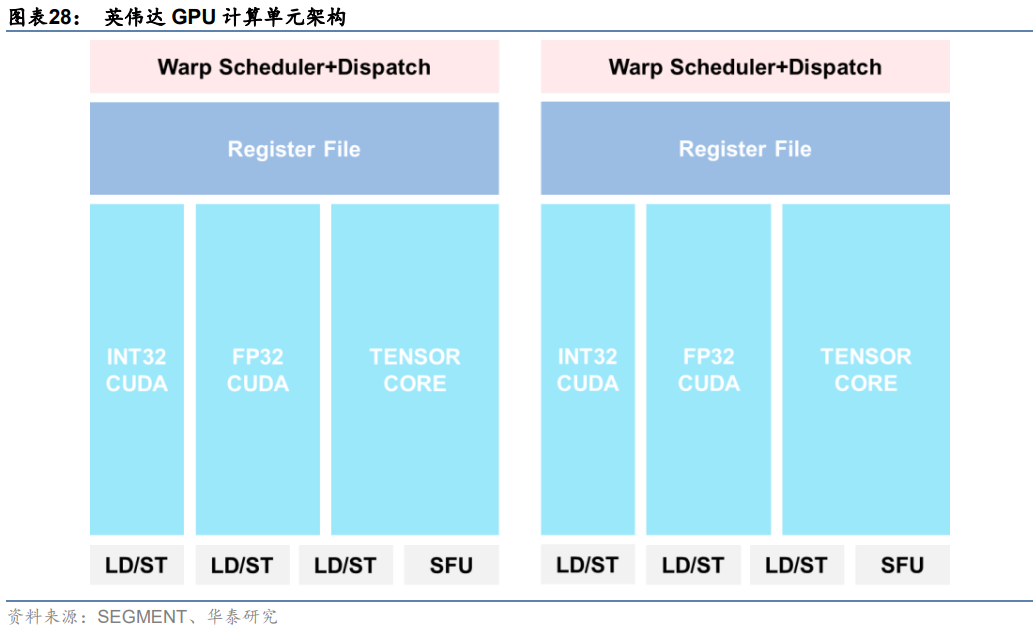

GPU结构:计算单元+显存。计算单元(Streaming Multiprocessor):计算单元的功能是执行计算。其中每一个SM都有独立的控制单元、寄存器、缓存、指令流水线。显存(Global Memory):显存是在GPU板卡上的DRAM,容量大但速度慢。1.计算单元底层架构:

显卡核心构成多样,不同核心专注不同任务。以英伟达为例,GPU显卡构成包括TENSOR CORE、CUDA和RT等部分。TENSOR CORE,即张量核心,是英伟达GPU上一块特殊区域,针对AI矩阵计算设计,可显著提高AI训练吞吐量和推理性能。CUDA则是英伟达生态中的通用结构,一般包括多个数据类型,适用于视频制作,图像处理,三维渲染等常见图像处理和计算工作。

2、TOPS和TFLOPS是常见算力衡量单位:

1)OPS:OPS(Operations Per Second)指每秒执行的操作次数,是整数运算的单位,常在INT8、INT4等计算精度下度量算力性能。其中TOPS(Tera Operations Per Second)代表处理器每秒钟可进行一万亿次(10^12)操作,类似的单位还有诸如GOPS、MOPS,均代表每秒的操作次数。2)FLOPS:FLOPS(Floating-point Operations Per Second)指每秒所执行的浮点运算次数,常在单精度(FP32)、半精度(FP16)等计算精度下度量算力性能。TFLOPS(Tera Floating-point Operations Per Second)代表处理器每秒钟可进行一万亿次(10^12)浮点运算。虽然TOPS和TFLOPS数量级一样,但前者是衡量操作次数,后者是衡量浮点运算,TOPS要结合数据类型精度(如INT8,FP16等)才能与FLOPS转换。3.显存位宽、带宽与容量:

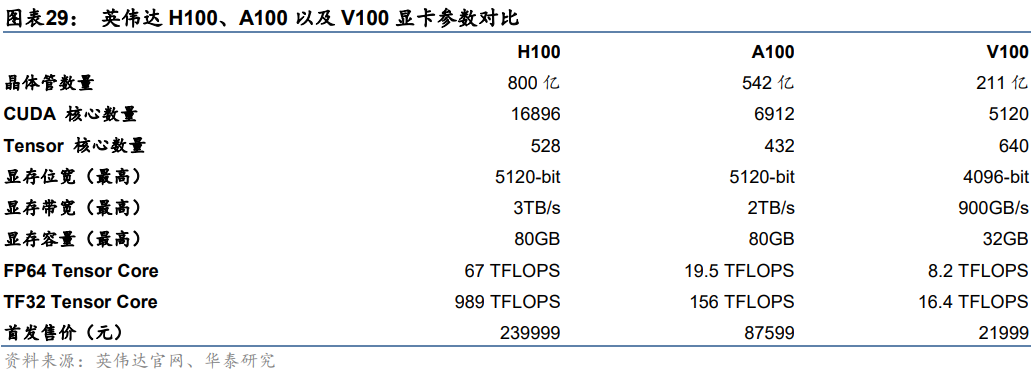

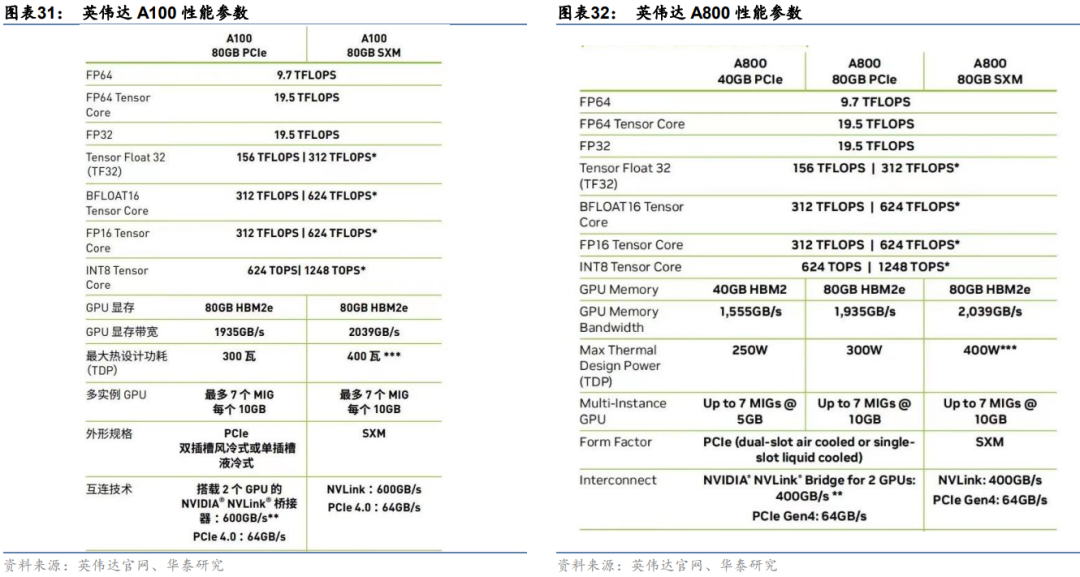

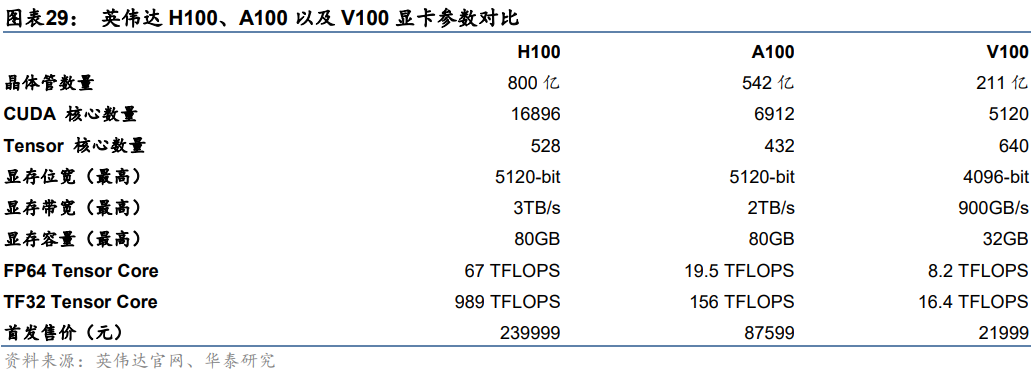

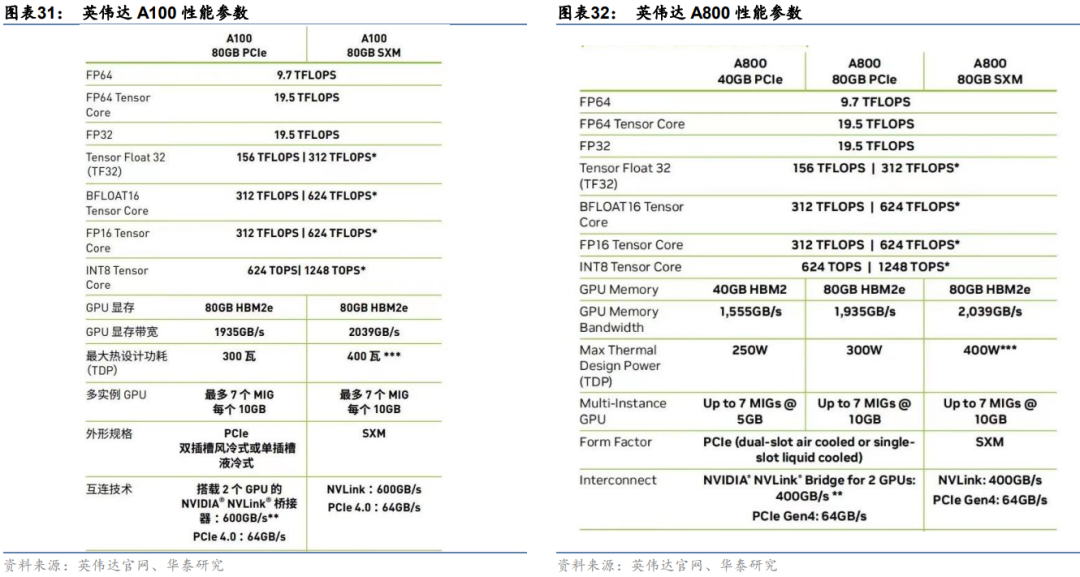

显存的主要指标包括位宽、带宽和容量。显存本身与CPU的内存类似,将数据在GPU核心与磁盘间传输。显存位宽是显存在一个时钟周期内所能传送数据的位数,决定了显存瞬时传输的数据量。显存带宽是指显示芯片与显存之间的数据传输速率,由显存频率和显存位宽共同决定,体现了显卡的速度和性能。显存容量决定了显存临时存储数据的多少。目前主流AI GPU芯片包括英伟达H100、A100以及V100等。全球来看,目前用于人工智能训练的AI GPU市场以英伟达为主导,公司旗下先进算力产品主要包括H100、A100以及V100。对比双精度浮点计算性能(FP64 Tensor Core)来看,H100、A100、V100计算速度分别为67 TFLOPS、19.5 TFLOPS、8.2 TFLOPS。从显存带宽来看,H100、A100、V100传输速度分别为3TB/s、2TB/s、900GB/s。

先进算力芯片进口受限或为国产AI服务器的瓶颈之一。2022年10月7日,美国商务部工业与安全局(BIS)宣布了针对中国出口先进芯片的管制新规声明。声明规定,满足输入输出(I/O)双向传输速度高于 600GB/s,同时每次操作的比特长度乘以 TOPS 计算出的处理性能合计为 4800 或更多算力的产品,将无法出口至中国。以英伟达A100为例,以TF32性能测算,即156*32=4992>4800,且传输速度为600GB/s。基于此,我们可以推断,性能大于等于A100 GPU的先进算力芯片属于美国出口限制范围。采用英伟达A800服务器或为当前可行替代方案。以浪潮NF5688M6为例,NF5688M6是为超大规模数据中心研发的NVLink AI 服务器,支持2颗Intel最新的Ice Lake CPU和8颗NVIDIA最新的NVSwitch全互联A800GPU,单机可提供5PFlops的AI计算性能。对比核心硬件来看,NF5688M6采用英伟达中国特供版芯片—A800,在浮点计算能力、显存带宽、显存容量等性能指标上,与先进算力芯片—A100基本一致,主要差异在于芯片的数据传输速度,约为A100的三分之二。

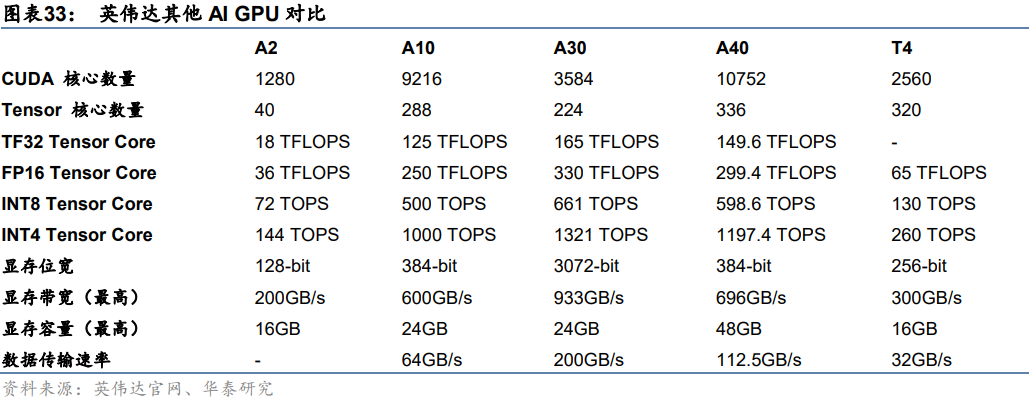

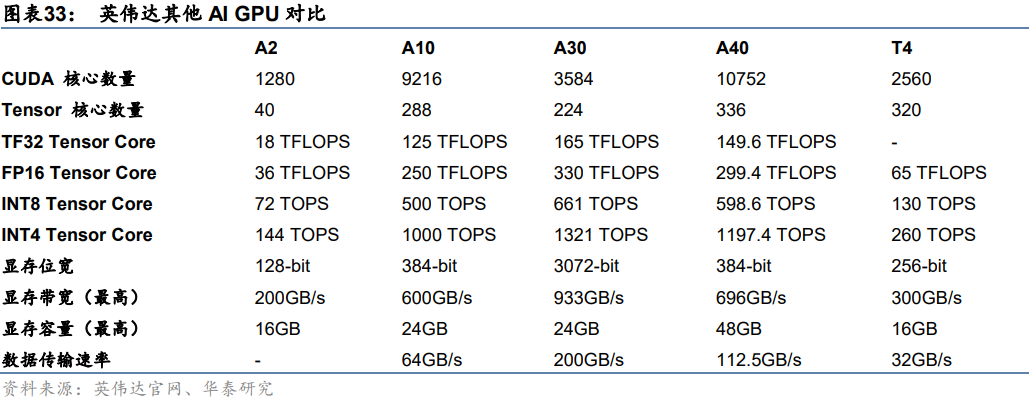

英伟达其他AI GPU芯片均不受出口限制影响。考虑到目前美国GPU芯片限制主要集中在先进算力领域,倘若未来进一步加大限制力度,A800等大算力芯片可能出现进一步被限制的风险。而从英伟达产品线布局来看,除了前面讨论的A100、A800、V100、H100等先进算力芯片外,还有A2、A10、A30、A40、T4等。这些芯片中,浮点计算能力最强的型号为A30,输出性能为82*32=2624<4800,因此不受出口限制影响。

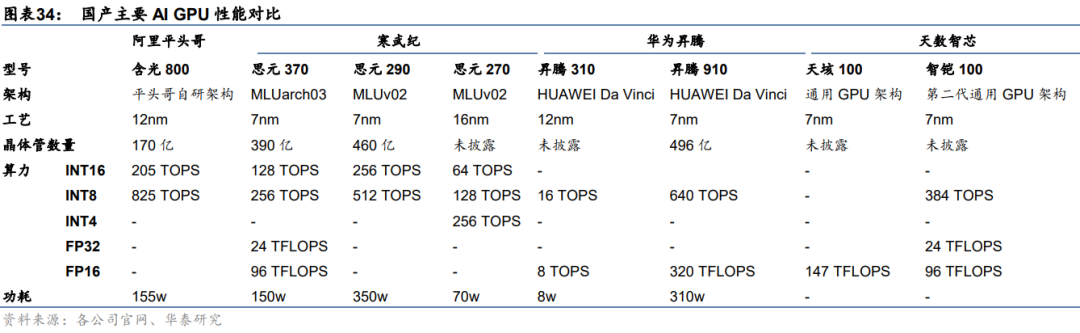

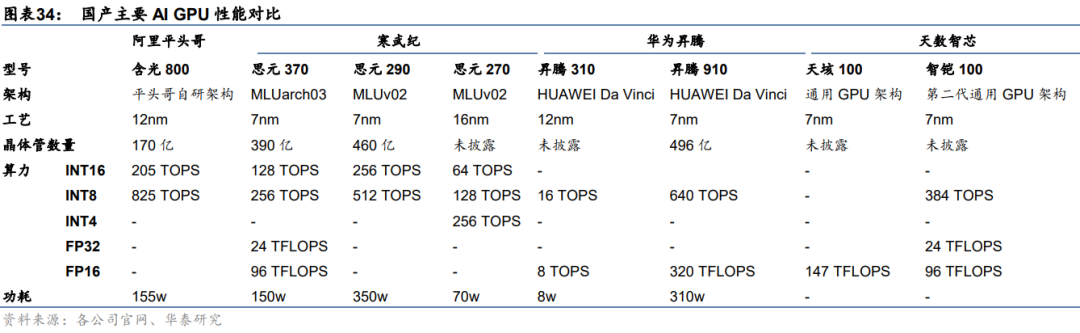

国产AI GPU性能持续升级,国产替代未来可期。目前国产AI GPU厂商主要包括阿里、华为、寒武纪、天数智芯等。随着国内厂商持续加强GPU研发,产品力不断升级。以华为昇腾910为例,该款芯片采用7nm制程,集成了超496亿个晶体管,可以提供320TFLOPS的FP16计算速度或640TOPS的INT8算力,略高于英伟达A100的FP16计算速度(312TFLOPS,不采用英伟达稀疏技术)。我们认为,单纯从芯片算力性能来看,部分国产芯片已经能够追赶海外主流芯片。随着国产生态逐步打磨,GPU性能提升有望推动国产化替代。

总结:

1、GPT模型需要什么样的算力?

ChatGPT采用单一大模型路线,对底层算力的需求主要体现在训练和推理两个层面,训练即使用大量数据集,对模型做反复迭代计算,推理即利用模型对输入信息进行处理并给出结果。据IDC数据,2021年中国人工智能服务器工作负载中,57.6%的负载用于推理,42.4%用于模型训练。具体来看,算力需求场景包括预训练、Finetune以及日常运营。根据我们的测算,GPT-3 175B模型需要的预训练算力约3640 PFlop/s-day、ChatGPT单月运营需要的算力约7034.7 PFlop/s-day、单月Finetune需要的算力至少为1350.4 PFlop/s-day。2、GPT模型需要什么样的服务器?

我们认为,服务器类型不断演化的动力来自:计算架构的变化。从服务器产业发展历程来看,随着计算架构从单机到C-S、C-E-S,陆续演化出PC、云计算、边缘计算等服务器类型。而在AI训练时代,C-S架构的回归以及大规模并行计算需求,又带来AI服务器的扩张。对比传统服务器来看,AI服务器由于采用GPU等加速卡,更加擅长向量、张量计算,对于AI训练及推理场景的处理能力更强,且采用多芯片组合架构,单台服务器芯片成本也较高。3、GPT模型需要什么样的算力芯片?

GPT模型的训练和推理计算主要由AI服务器完成,底层算力芯片主要包括CPU、GPU、FPGA、ASIC等。常见的算力芯片组合,如8x GPU+2x CPU、4x GPU+ 2x CPU、8x FPGA+1x CPU、4x FPGA+1x CPU等。据IDC,2022年国内人工智能芯片市场中,GPU芯片占据主要市场份额,达89.0%。目前海外主流AI GPU芯片包括英伟达H100、A100以及V100等。4、美国先进算力芯片出口限制对GPT产业的影响?

受美国先进算力芯片出口限制政策影响,目前国内只能采购性能低于A100的AI GPU,如英伟达A800系列等。此外,英伟达A系列、T系列性能更低的前代版本尚且不受影响。考虑到部分国产AI GPU如华为昇腾在FP16浮点计算性能上已经实现对英伟达A100的加速追赶,未来随着国产生态打磨,AI GPU国产替代有望加速。5、AI服务器产业链相关公司有哪些?