Morgan Stanley 写了个“太空数据中心(space-based data centers)”的 note——我原以为是科幻频道,结果核心逻辑非常现实:AI 的瓶颈在从 GPU 挪去电力/散热/许可(power, cooling, permitting)。于是,“把 compute 搬到轨道上”突然变成一个能被摆上桌的选项。

• 大盘/利率/汇率/商品:素材未提供具体数字;我不硬聊 macro。

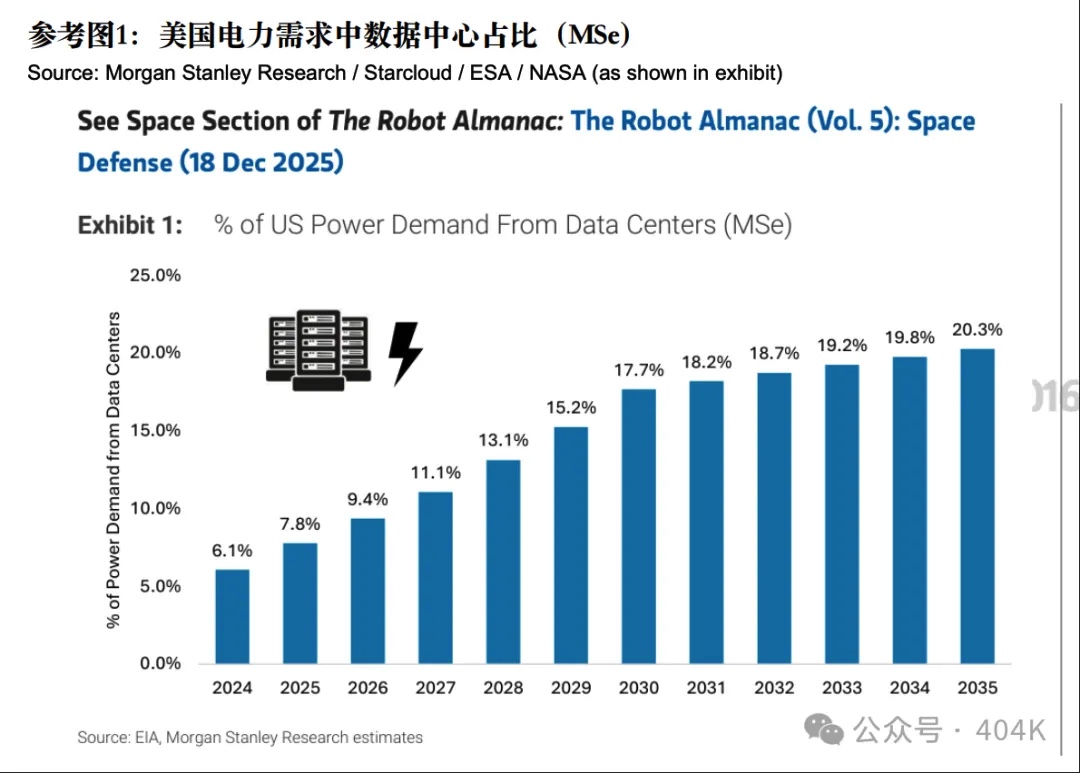

• 电力侧:研报给出路径——数据中心占美国电力需求,2024 年 6.1%→2026 年 9.4%→2035 年 20.3%。

• 散热侧:地面数据中心的制冷/散热,研报说可占到总能耗的 40%;而太空温度约 2.7K(-270°C),叙事上天然“好卖”。

• 供能侧:太空 solar constant 约 1,361 W/m²,研报称比地面最佳太阳能辐照(考虑大气衰减后)高约 30%。

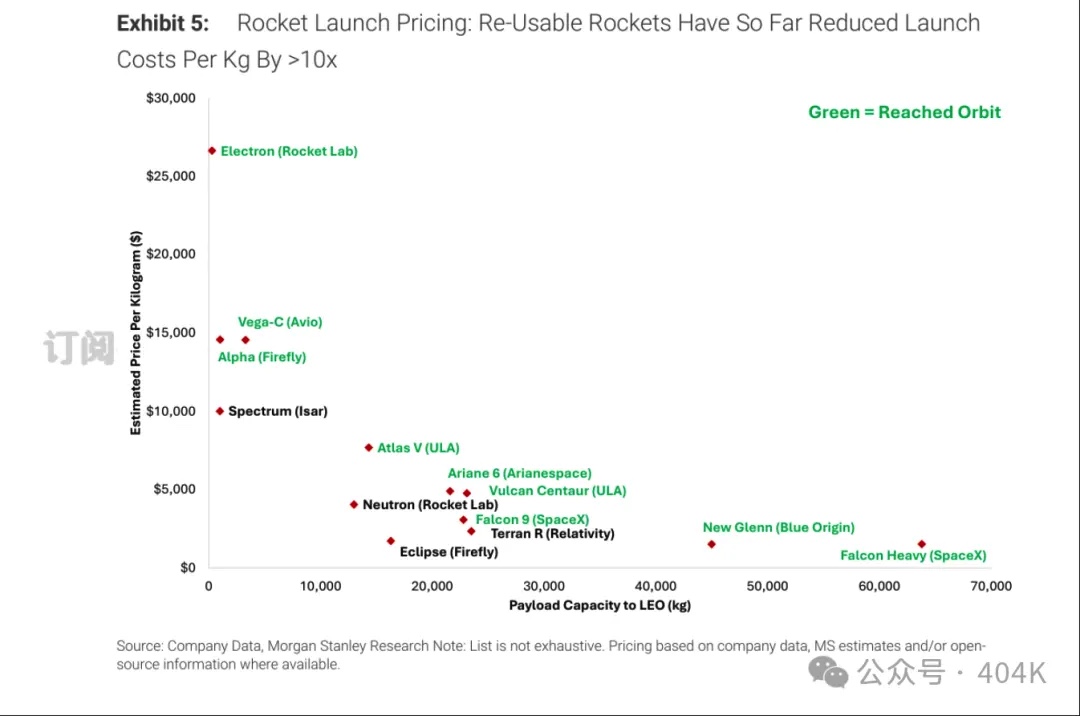

• 发射成本:可重复使用火箭把 LEO 成本/公斤压下来了 >10x;但要到 break-even,研报引用公司口径:大约需要 $500/kg,而当前仍是“几千美元/公斤”。

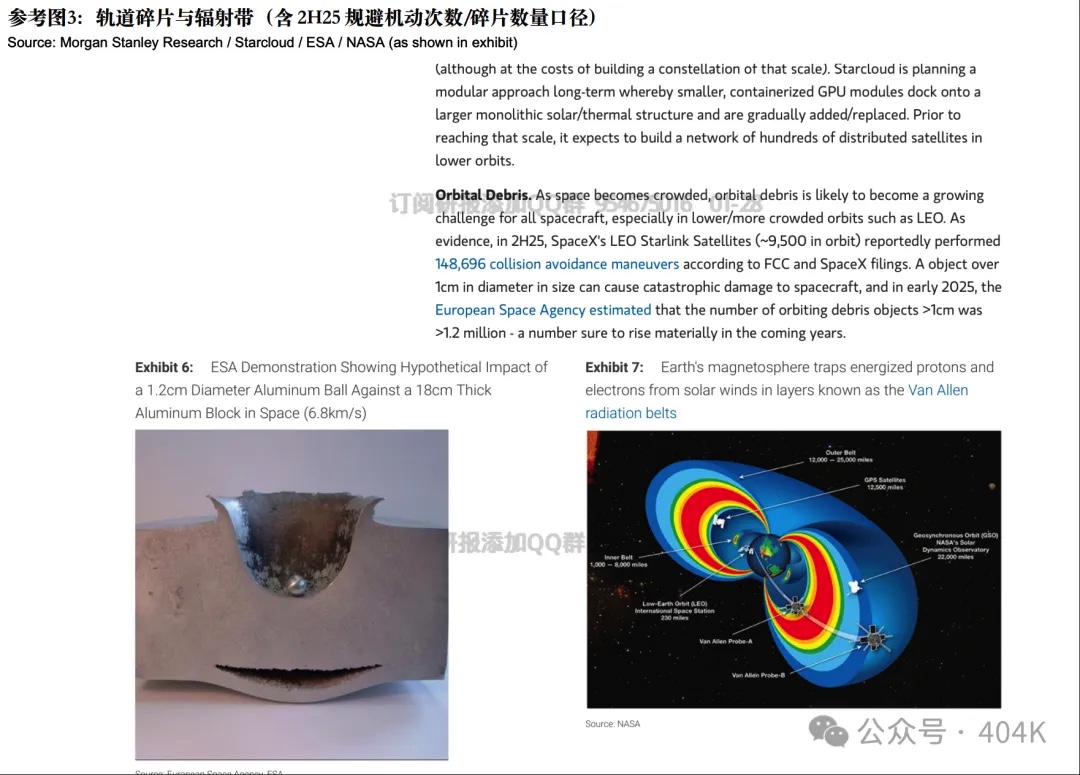

• 现实风险:2H25 Starlink(约 9,500 颗在轨)据称做了 148,696 次 collision avoidance maneuvers;ESA 估算 >1cm 的碎片数量 >120 万(均为研报引用口径)。

一句话:市场在交易“AI算力的下一道墙是电力与基础设施”,所以任何能绕开地面电网与选址/许可约束的新架构(including compute goes orbital)都会被当成长期 option 开始贴价格。

1/ 情绪怎么变:从 sci-fi fun fact 变成 infra/capex debate。研报甚至把话说死——“不容易;也许能规模化;但 2026 年你最好开始关注”。这种语气很交易台:不是让你明天买,而是让你别装没看见。

2/ 资金流怎么走:未提供 LO/HF/ETF 的具体流向与仓位;但“public & private markets 的投资对话都在聊”这句,基本等同于:主题已进入 fact gathering。

(我/404K:每次看到“reshaping investment conversations”,我就知道下一步会有人问我——有没有标的、有没有链条、有没有 beta。)

3/ 叙事怎么演化:过去大家交易“GPU 供给”;现在叙事往后挪:power & cooling & permitting。研报给了一个更尖锐的直觉:地面数据中心成本可能在通胀;而进入低轨的成本可能在通缩。两条曲线的交叉点,才是“上天”从段子变账本的时刻。

4/ 公司与产业链怎么串:

Starcloud(私人公司)是这份报告的主角:2024 年成立;2025 年 11 月把 NVIDIA H100 送上轨道,做了 on-orbit inference,并训练了 Google Gemma 与 OpenAI NanoGPT;公司声称这次任务让“在轨 AI 算力”相对过往提升 100x。

下一步:Starcloud-2 计划 late 2026,上 Blackwell B200 GPU cluster,并宣称具备 persistent storage、24/7 access;研报写到其发电能力相对 Starcloud-1 至少 10x。同时 Crusoe 合作方目标是 early 2027 提供“limited GPU capacity from space”。

资金面:PitchBook 口径,Starcloud 累计融资 $27.5mn;2025 年 3 月有一轮 $10mn seed,PitchBook 报告估值 $100mn。

竞争者/旁支也在起势:Google 的 Project Suncatcher 计划 early 2027 发射两颗原型星;并推演到 mid-2030s 有望接近地面数据中心 cost parity(研报口径)。Axiom Space(研报引 PitchBook)融资 >$700mn;Aetherflux 目标 1Q27 首个商业节点;还有 Sophia Space($13.5mn)与 Lonestar($12.7mn)等。

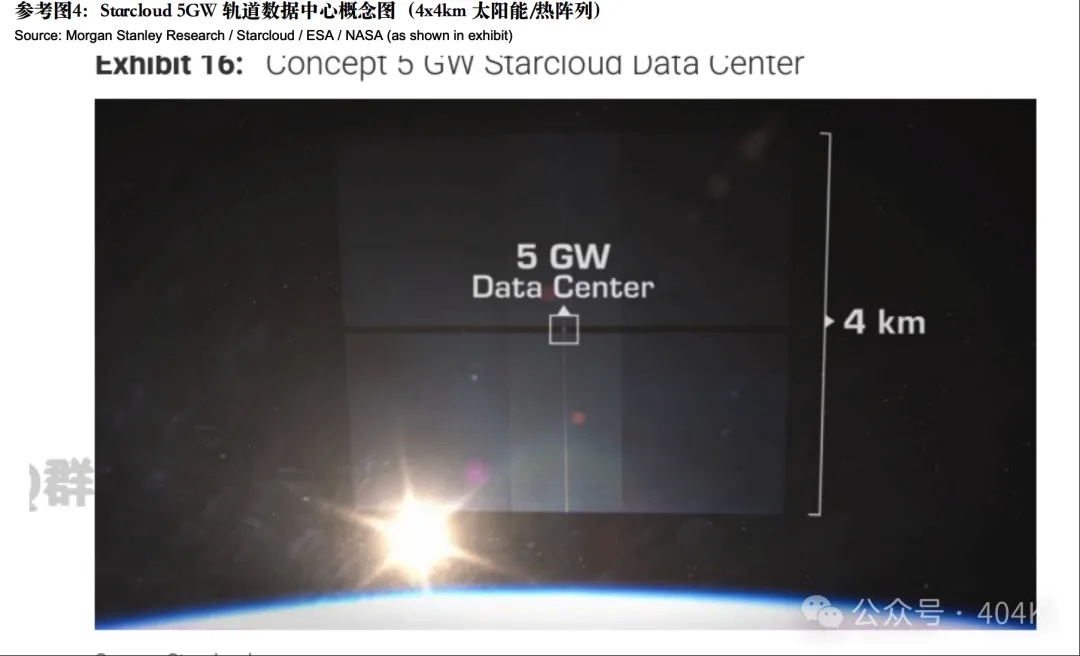

5/ 路径选择:先 inference,后 training:研报不鼓励你想象“一个 100 万平方英尺(shopping mall sized)的低轨数据中心”。它更像是:成千上万颗 MW/sub-MW 节点,通过 optical inter-satellite links 连接;先做 inference 的分布式网络,再谈大模型训练。

它还提了一个对照物:Distributed Inference Cloud(用终端设备的 on-device compute 组成蜂群算力云)。研报说两者是同一枚硬币的两面——一个把算力分散到“地面终端”,一个把算力分散到“轨道节点”。

6/ 争论点A:Economics——到底能不能算过账?

多头怎么说:re-usability 已带来 >10x 的降本;还有“进一步 10x 降本”的技术在路上;太空太阳能更强(1,361 W/m²、高约 30%),散热可能更省(地面制冷可占 40%)。发射成本继续下行,space compute 逼近 cost parity 只是时间问题。

空头怎么说:公司自己也说 break-even 需要 ~$500/kg,但现在还是“几千美元/公斤”;而且大幅降本依赖 Starship 等 heavy launch vehicles,研报写得很直白:可能要到 2030s 才能 full commercial scale。你现在谈经济性,本质是谈“时间贴现”。

我现在站哪边:我把它当 long-dated call。它短期不解释任何季度业绩,但会改变我们给“发射成本曲线/电力约束/在轨连接与热管理”定战略权重的方式。

7/ 争论点B:Architecture——分布式 vs. 一体式,谁先落地?

多头怎么说:分布式(hundreds/thousands of satellites)天然更能分散维修/替换/碎片风险;capex 更像按需扩容;先把 inference 做成生意。Starcloud 的路线图也偏这条:先 VLEO/LEO 的小节点,再去更高轨做 GW 级结构。

空头怎么说:training 是 tightly coupled workload,最后还是需要更集中、更复杂的一体式结构;而更高轨拿连续日照,就要更强辐射防护、更难维护。还有硬件迭代:GPU 18-24 个月一代;卫星 3-5 年自然脱轨“顺带更换”听着很美,但等价于长期持续发射节奏。

我现在站哪边:inference 先上天、training 仍在地面——这是我当前最节制的 base case。

8/ 一句引述/机翻(研报原文):

“Not in the slightest.”

翻成人话:这不是 PPT 创业;是工程+资本的耐力赛。别把“能不能”当成一个问题;真正的问题是“什么时候、以什么成本、谁来承担运维与安全”。

结论先行:Space-based data centers 不是 2026 年的“业绩线”,更像 2026 年开始被定价的“战略线”。

① 我更确信的:AI 的 next bottleneck 正从 chip 迁移到 power/cooling/permitting;当“数据中心用电占比”能被写到 9.4%(2026)→20.3%(2035) 这种路径上时,任何“离开地面电网”的方案都会获得讨论权。

② 我还没想清楚的:$500/kg 这条线到底靠什么实现、何时实现;以及“在轨 inference”到“在轨 training”之间的鸿沟,究竟是工程问题还是商业问题(我怀疑两者叠加)。

③ 最需要盯的数据/事件:Starcloud-2(late 2026)能否把 B200 cluster + persistent storage + 24/7 access 做成“可卖服务”;Crusoe early 2027 的 “limited GPU capacity from space”能否落地;以及发射成本是否出现研报提到的“再 10x”拐点。

风险提示我放一句就够:这篇只是把研报信息做了一次交易台式整理;不构成投资建议,也不替任何口径背书——尤其是那些还没被现金流检验的部分。

从设计到生产

灏域为您提供

全产业链解决方案

开始我们的合作

+86 18600523371